Meta zverejňuje kód v umelej inteligencii s otvoreným prístupom pod názvom imagebind, ktorá predpovedá vzťahy medzi dátami podobné tomu, ako ľudia vnímajú alebo si predstavujú svoje prostredie. Zatiaľ čo generátory obrázkov ako Midjourney, Stable Diffusion a DALL-E 2 viažu slová k obrázkom, čo vám umožňuje vytvárať vizuálne scény len na základe textového popisu, ImageBind ide ďalej. Dokáže prepojiť text, obrázky alebo video, zvuk, 3D merania, údaje o teplote a údaje o pohybe – a robí to bez potreby predbežného tréningu pri každej príležitosti. Toto je počiatočná fáza rámca, ktorý bude nakoniec schopný generovať zložité prostredia z jednoduchých vstupov, ako je textová výzva, obrázok alebo zvuk (alebo ich kombinácia).

ImageBind si môžete predstaviť ako aproximáciu strojového učenia k ľudskému učeniu. Napríklad, ak stojíte v dynamickom prostredí, ako je rušná mestská ulica, váš mozog (väčšinou nevedome) absorbuje pohľady, zvuky a iné zmyslové vnemy, aby získal informácie o prechádzajúcich autách, vysokých budovách, počasí a podobne. . Ľudia a iné zvieratá sa vyvinuli na spracovanie týchto údajov pre naše genetické výhody: prežitie a odovzdávanie našej DNA. (Čím viac viete o svojom okolí, tým viac sa môžete vyhnúť nebezpečenstvu a prispôsobiť sa svojmu prostrediu, aby ste lepšie prežili a prosperovali). Ako sa počítače približujú k napodobňovaniu multisenzorických spojení zvierat, môžu tieto spojenia použiť na generovanie plne realizovaných scén založených len na obmedzených kusoch údajov.

Takže zatiaľ čo môžete použiť Midjourney na vytvorenie „basseta v kostýme Gandalfa balansujúceho na plážovej lopte“ a získať relatívne realistickú fotografiu tejto podivnej scény, multimodálny nástroj AI ako ImageBind môže skončiť vytvorením videa so psom s relevantnými zvuky vrátane detailnej obývačky, izbovej teploty a presnej polohy psa a všetkých ostatných na scéne. "Toto vytvára vynikajúcu príležitosť na vytváranie animácií zo statických obrázkov ich kombináciou so zvukovými výzvami," poznamenávajú výskumníci z Meta vo svojom blogu zameranom na vývojárov. "Napríklad, tvorca môže skombinovať obrázok s budíkom a kohútom kikiríkajúcim kohútom a použiť zvukovú stopu na segmentovanie kohúta alebo zvuk budíka na segmentovanie hodín a animovať oboje vo videosekvencii."

Čo sa ešte dá urobiť s touto novou hračkou, jasne poukazuje na jednu zo základných ambícií Meta: VR, zmiešanú realitu a metapriestor. Predstavte si napríklad budúcu náhlavnú súpravu, ktorá dokáže za chodu vytvárať plne realizované 3D scény (so zvukom, pohybom atď.). Alebo by to vývojári virtuálnych hier mohli nakoniec použiť na to, aby si ušetrili značnú časť starostlivej práce v procese navrhovania. Podobne by tvorcovia obsahu mohli vytvárať pohlcujúce videá s realistickými zvukovými stopami a pohybom len na základe textu, obrázkov alebo zvuku. Je tiež ľahké si predstaviť, ako nástroj ako ImageBind otvára nové dvere v prístupnosti generovaním multimediálnych popisov v reálnom čase, ktoré pomáhajú ľuďom so zrakovým alebo sluchovým postihnutím lepšie porozumieť svojmu prostrediu.

Tiež zaujímavé: Najlepšie nástroje založené na umelej inteligencii

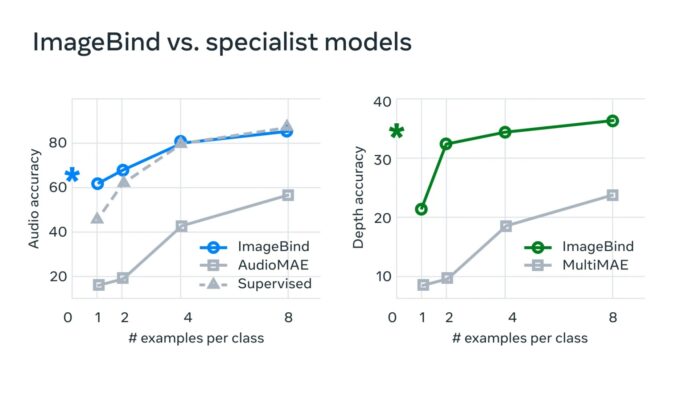

„V typických systémoch AI existuje špecifické vloženie (tj vektory čísel, ktoré môžu reprezentovať údaje a ich vzťahy v strojovom učení) pre každú relevantnú modalitu,“ hovorí Meta. „ImageBind ukazuje, že je možné vytvoriť spoločný priestor pre vkladanie viacerých modalít bez toho, aby ste museli trénovať na dátach s každou jednotlivou kombináciou modalít. Je to dôležité, pretože výskumníci nemôžu vytvárať súbory údajov so vzorkami, ktoré obsahujú napríklad zvukové údaje a tepelné údaje z rušnej mestskej ulice alebo údaje o hĺbke a textový popis prímorského útesu.“

Meta verí, že táto technológia časom takpovediac presiahne súčasných šesť „zmyslov“. "Aj keď sme v našej súčasnej štúdii skúmali šesť modalít, veríme, že zavedenie nových modalít, ktoré spájajú čo najviac zmyslov - ako je dotyk, reč, čuch a fMRI mozgové signály - umožní bohatšie modely AI zamerané na človeka." Vývojári, ktorí majú záujem preskúmať tento nový sandbox, môžu začať ponorením sa do otvoreného zdrojového kódu Meta.

Prečítajte si tiež: